| 번호 | 청구항 |

|---|---|

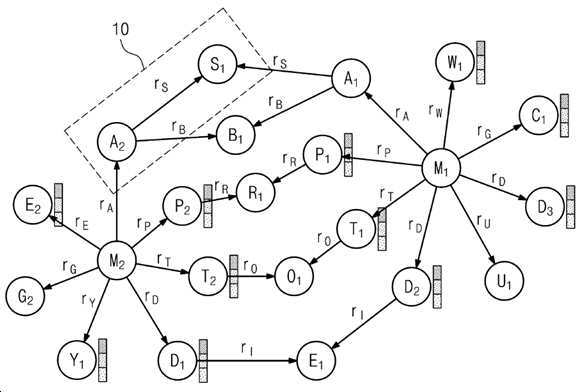

| 1 | 하나 이상의 프로세서에 의하여 수행되는 기계학습 모델의 학습 방법으로써, 상기 기계학습 모델의 학습 방법은:상기 기계학습 모델에 포함된 임베딩 모델의 사전 학습 단계;를 포함하고,상기 사전 학습 단계는,지식 그래프에 포함된 제1 엔티티 및 상기 제1 엔티티의 이웃 엔티티인 제2 엔티티를 선택하는 단계;상기 제1 엔티티에 대한 제1 이종 결합 벡터를 생성하는 단계;상기 제2 엔티티에 대한 제2 이종 결합 벡터를 생성하는 단계;상기 제1 이종 결합 벡터 및 상기 제2 이종 결합 벡터로부터, 상기 제1 엔티티에 대한 제1 임베딩 및 상기 제2 엔티티에 대한 제2 임베딩을 생성하는 단계; 및상기 제1 임베딩 및 상기 제2 임베딩으로부터, 손실 값을 연산하는 단계;상기 손실 값에 기초하여, 상기 임베딩 모델을 학습시키는 단계;를 포함하고,상기 이종 결합 벡터는, 복수의 유형의 특성 데이터를 고정 크기 벡터로 결합한 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 2 | 제1 항에 있어서,상기 이종 결합 벡터를 생성하는 단계는,게이트 함수(gate function)를 이용하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 3 | 제2 항에 있어서,상기 지식 그래프에 포함된 엔티티 각각은 엔티티 특성 데이터로 표현되고,상기 엔티티 특성 데이터는 제1 유형 데이터 및 제2 유형 데이터를 포함하고,상기 이종 결합 벡터를 생성하는 단계는,상기 제1 유형 데이터를 제1 유형 특징 벡터로 변환하는 단계;상기 제2 유형 데이터를 제2 유형 특징 벡터로 변환하는 단계; 및상기 게이트 함수, 상기 제1 유형 특징 벡터 및 상기 제2 유형 특징 벡터를 이용하여 상기 이종 결합 벡터를 생성하는 단계;를 포함하는,기계학습 모델의 학습 방법. |

| 4 | 제3 항에 있어서,상기 게이트 함수, 상기 제1 유형 특징 벡터 및 상기 제2 유형 특징 벡터를 이용하여 상기 이종 결합 벡터를 생성하는 단계는,하나 이상의 학습 가능한 가중치 데이터를 이용하여, 상기 제1 유형 특징 벡터 및 상기 제2 유형 특징 벡터에 대한 선형 투영 연산을 수행하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 5 | 제4 항에 있어서,상기 제1 유형 데이터는 문언적(literal) 정보인 엔티티 데이터이고,상기 제1 유형 특징 벡터는 상기 엔티티 데이터에 대응하는 엔티티 벡터인 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 6 | 제1 항에 있어서,상기 제1 임베딩을 생성하는 단계는,제1 잠재 표현 출력층을 이용하여, 상기 제1 이종 결합 벡터 및 상기 제2 이종 결합 벡터로부터 제1 엔티티 잠재 표현 벡터를 생성하는 단계;를 포함하는,기계학습 모델의 학습 방법. |

| 7 | 제6 항에 있어서,상기 제1 임베딩을 생성하는 단계는,제2 잠재 표현 출력층으로부터 생성된 제2 엔티티 잠재 표현 벡터를 생성하는 단계;를 포함하고,상기 제2 엔티티 잠재 표현 벡터를 생성하는 단계는,상기 제1 엔티티의 이웃 엔티티 각각에 대한 제1 상관도를 연산하는 단계; 및상기 제1 엔티티 잠재 표현 벡터와, 상기 제1 엔티티의 이웃 엔티티 각각에 대한 제1 상관도를 이용하여 상기 제2 엔티티 잠재 표현 벡터를 생성하는 단계;를 포함하는,기계학습 모델의 학습 방법. |

| 8 | 제7 항에 있어서,상기 제1 엔티티의 이웃 엔티티 각각에 대한 제1 상관도는,어텐션 연산을 이용하여 생성되는,기계학습 모델의 학습 방법. |

| 9 | 제7 항에 있어서,상기 제1 엔티티 잠재 표현 벡터와, 상기 제1 엔티티의 이웃 엔티티 각각에 대한 제1 상관도를 이용하여 상기 제2 엔티티 잠재 표현 벡터를 생성하는 단계는,상기 제1 엔티티의 이웃 엔티티 각각에 대한 제1 상관도에 기초하여, 상기 제1 엔티티의 이웃 엔티티에 대한 제1 이웃 잠재 표현 벡터를 생성하는 단계; 및병합(aggregation) 함수를 이용하여, 상기 제1 엔티티 잠재 표현 벡터 및 상기 제1 이웃 잠재 표현 벡터에 대해 병합을 수행하는 단계;를 포함하는,기계학습 모델의 학습 방법. |

| 10 | 제8 항에 있어서,상기 제1 잠재 표현 출력층은,상기 제1 엔티티로부터 제1 홉(hop) 거리에 있는 엔티티를 이웃 엔티티로 결정하고,상기 제2 잠재 표현 출력층은,상기 제1 엔티티로부터 제2 홉 거리에 있는 엔티티를 이웃 엔티티로 결정하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 11 | 제10 항에 있어서,상기 제2 홉은 상기 제1 홉보다 큰 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 12 | 제7 항에 있어서,상기 제1 잠재 표현 출력층 또는 상기 제2 잠재 표현 출력층 중 적어도 하나는,잔차 연결(residual connection)을 포함하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 13 | 제7 항에 있어서,상기 제1 임베딩을 생성하는 단계는,상기 제1 엔티티 잠재 표현 벡터 및 상기 제2 엔티티 잠재 표현 벡터를 병합하는 단계;를 포함하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 14 | 제13 항에 있어서,상기 제1 엔티티 잠재 표현 벡터 및 상기 제2 엔티티 잠재 표현 벡터를 병합하는 단계는,상기 제1 엔티티 잠재 표현 벡터 및 상기 제2 엔티티 잠재 표현 벡터를 연결(concatenate)하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 15 | 제1 항에 있어서,상기 제1 엔티티와 상기 제2 엔티티는 제1 관계 데이터에 의하여 상기 지식 그래프 상에서 이웃 엔티티로 표현되고,상기 손실 값은, 상기 제1 관계 데이터가 상기 지식 그래프 상에서 표현되는 경우, 상기 손실 값이 감소하고,상기 제1 관계 데이터가 상기 지식 그래프 상에서 표현되지 않는 경우, 상기 손실 값이 증가하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 16 | 제15 항에 있어서,상기 손실 값은,트리플렛 손실(triplet loss)을 이용하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 17 | 제1 항에 있어서,상기 기계학습 모델은,하나 이상의 층으로 구성되어, 상기 임베딩 모델과 연결된 임베딩 변환 모델을 더 포함하고,상기 기계학습 모델의 학습 방법은,상기 임베딩 모델을 이용하여 생성된, 제1 의료 엔티티(medical entity)에 대응하는 제1 의료 임베딩 및 제2 의료 엔티티에 대응하는 제2 의료 임베딩을 입력받는 단계;상기 임베딩 변환 모델을 이용하여, 상기 제1 의료 임베딩 및 상기 제2 의료 임베딩으로부터 상기 제1 의료 엔티티와 상기 제2 의료 엔티티 간의 제2 상관도를 연산하는 단계;를 포함하는,기계학습 모델의 학습 방법. |

| 18 | 제17 항에 있어서,상기 제1 의료 엔티티 또는 상기 제2 의료 엔티티는 질병 데이터인 것을 특징으로 하는,기계학습 모델의 학습 방법. |

| 19 | 제17 항에 있어서,상기 임베딩 변환 모델은, 완전 연결층(fully connected layer)을 포함하는 것을 특징으로 하는,기계학습 모델의 학습 방법. |