| 번호 | 청구항 |

|---|---|

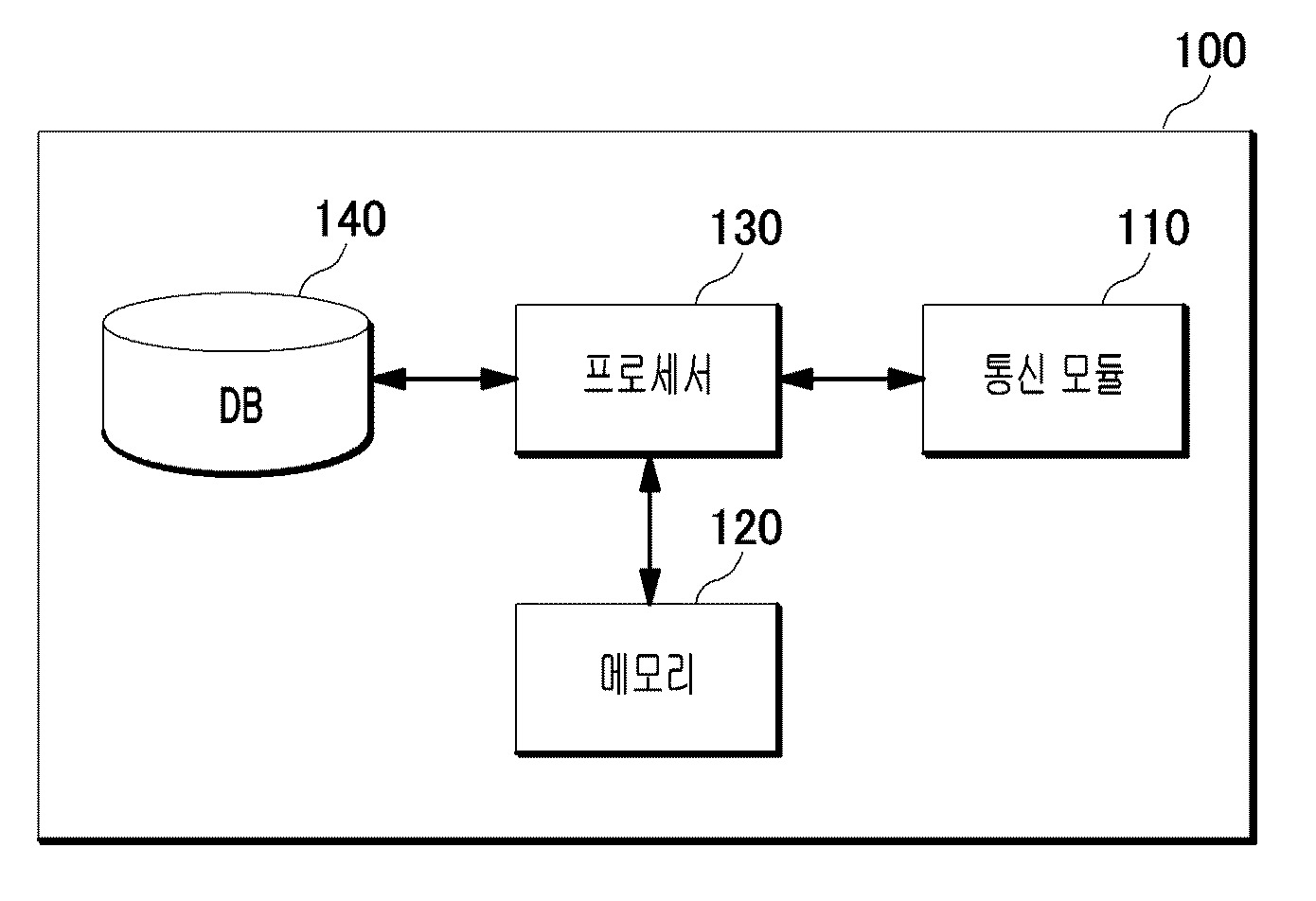

| 1 | 선호 관계 데이터를 이용한 인공지능 에이전트의 학습 장치에 있어서, 인공지능 에이전트 학습 프로그램이 저장된 메모리; 및상기 메모리에 저장된 프로그램을 실행하는 프로세서를 포함하며, 상기 프로그램은, (a) 선호 관계가 채점된 기존 데이터 세트를 이용하여 선호 관계 예측기를 학습하는 단계, (b) 신규 데이터 세트를 상기 선호 관계 예측기에 입력하여 선호 관계 채점이 완료된 전체 데이터 세트를 생성하는 단계, 및 (c) 상기 전체 데이터 세트를 기초로 인공지능 에이전트를 학습하는 단계를 수행하는 것이되,상기 기존 데이터 세트는 상태와 행동의 순서쌍의 나열로 이루어진 두 개의 궤적과 라벨 정보를 포함하는 것이고,상기 신규 데이터 세트는 상태와 행동의 순서쌍의 나열로 이루어진 두 개의 궤적을 포함하는 것인, 인공지능 에이전트의 학습 장치. |

| 2 | 제1항에 있어서, 상기 인공지능 에이전트에 상태가 입력되면 학습된 정책망에 기초하여 라벨 정보가 반영된 행동이 출력되는 것인, 인공지능 에이전트의 학습 장치. |

| 3 | 제1항에 있어서, 수학식1에 의해, 상기 선호 관계 예측기를 학습하는 것인, 인공지능 에이전트의 학습 장치.003c#수학식1003e# 여기서, Φ는 선호 관계 예측기의 학습 가능한 매개변수이고, PΦ는 선호 관계 예측기이고, Dpref는 선호 관계가 채점된 기존 데이터 세트이고, D는 신규 데이터 세트이고, (σ0, σ1, y)는 Dpref의 원소로서 두 개의 궤적과 라벨 정보(이때 y는 0 또는 1의 값임)의 순서쌍이고, v는 가중치로서 양의 값이고, (σ, σ’)은 D×D의 원소로서 많은 부분이 겹쳐 있는 두 개의 궤적의 순서쌍이다. |

| 4 | 제1항에 있어서, 수학식2에 의해, 상기 인공지능 에이전트를 학습하는 것인, 인공지능 에이전트의 학습 장치.003c#수학식2003e# 여기서, π는 정책망, σi 및 σj는 궤적을 나타내고, st 및 at는 궤적 σi의 일부분으로 각각 상태와 행동을 나타내고, d(π, σj)는 정책망과 궤적 사이의 거리에 해당하는 값이고, s(π, σi, σj)는 d(π, σj)를 기반으로 정의되되, d(π, σi)가 감소할수록 s(π, σi, σj)가 증가하고, d(π, σj)가 증가할수록 s(π, σi, σj)가 증가하도록 정의된 것이고, λ는 추가적인 매개변수(0과 1 사이의 값임)이고, S(θ; D)는 s(π, σi, σj)의 합으로 정의된 것이고, 는 신규 데이터 세트(D)에 대한 라벨 정보이다. |

| 5 | 선호 관계 데이터를 이용한 인공지능 에이전트 학습 장치의 학습 방법에 있어서,(a) 선호 관계가 채점된 기존 데이터 세트를 이용하여 선호 관계 예측기를 학습하는 단계; (b) 신규 데이터 세트를 상기 선호 관계 예측기에 입력하여 선호 관계 채점이 완료된 전체 데이터 세트를 생성하는 단계; 및(c) 상기 전체 데이터 세트를 기초로 인공지능 에이전트를 학습하는 단계;를 포함하되,상기 기존 데이터 세트는 상태와 행동의 순서쌍의 나열로 이루어진 두 개의 궤적과 라벨 정보를 포함하는 것이고,상기 신규 데이터 세트는 상태와 행동의 순서쌍의 나열로 이루어진 두 개의 궤적을 포함하는 것인, 인공지능 에이전트 학습 장치의 학습 방법. |

| 6 | 제5항에 있어서, 상기 인공지능 에이전트에 상태가 입력되면 학습된 정책망에 기초하여 라벨 정보가 반영된 행동이 출력되는 것인, 인공지능 에이전트 학습 장치의 학습 방법. |

| 7 | 제5항에 있어서, 수학식1에 의해, 상기 선호 관계 예측기를 학습하는 것인, 인공지능 에이전트 학습 장치의 학습 방법.003c#수학식1003e# 여기서, Φ는 선호 관계 예측기의 학습 가능한 매개변수이고, PΦ는 선호 관계 예측기이고, Dpref는 선호 관계가 채점된 기존 데이터 세트이고, D는 신규 데이터 세트이고, (σ0, σ1, y)는 Dpref의 원소로서 두 개의 궤적과 라벨 정보(이때 y는 0 또는 1의 값임)의 순서쌍이고, v는 가중치로서 양의 값이고, (σ, σ’)은 D×D의 원소로서 많은 부분이 겹쳐 있는 두 개의 궤적의 순서쌍이다. |

| 8 | 제5항에 있어서, 수학식2에 의해, 상기 인공지능 에이전트를 학습하는 것인, 인공지능 에이전트 학습 장치의 학습 방법.003c#수학식2003e# 여기서, π는 정책망, σi 및 σj는 궤적을 나타내고, st 및 at는 궤적 σi의 일부분으로 각각 상태와 행동을 나타내고, d(π, σj)는 정책망과 궤적 사이의 거리에 해당하는 값이고, s(π, σi, σj)는 d(π, σj)를 기반으로 정의되되, d(π, σi)가 감소할수록 s(π, σi, σj)가 증가하고, d(π, σj)가 증가할수록 s(π, σi, σj)가 증가하도록 정의된 것이고, λ는 추가적인 매개변수(0과 1 사이의 값임)이고, S(θ; D)는 s(π, σi, σj)의 합으로 정의된 것이고, 는 신규 데이터 세트(D)에 대한 라벨 정보이다. |