| 번호 | 청구항 |

|---|---|

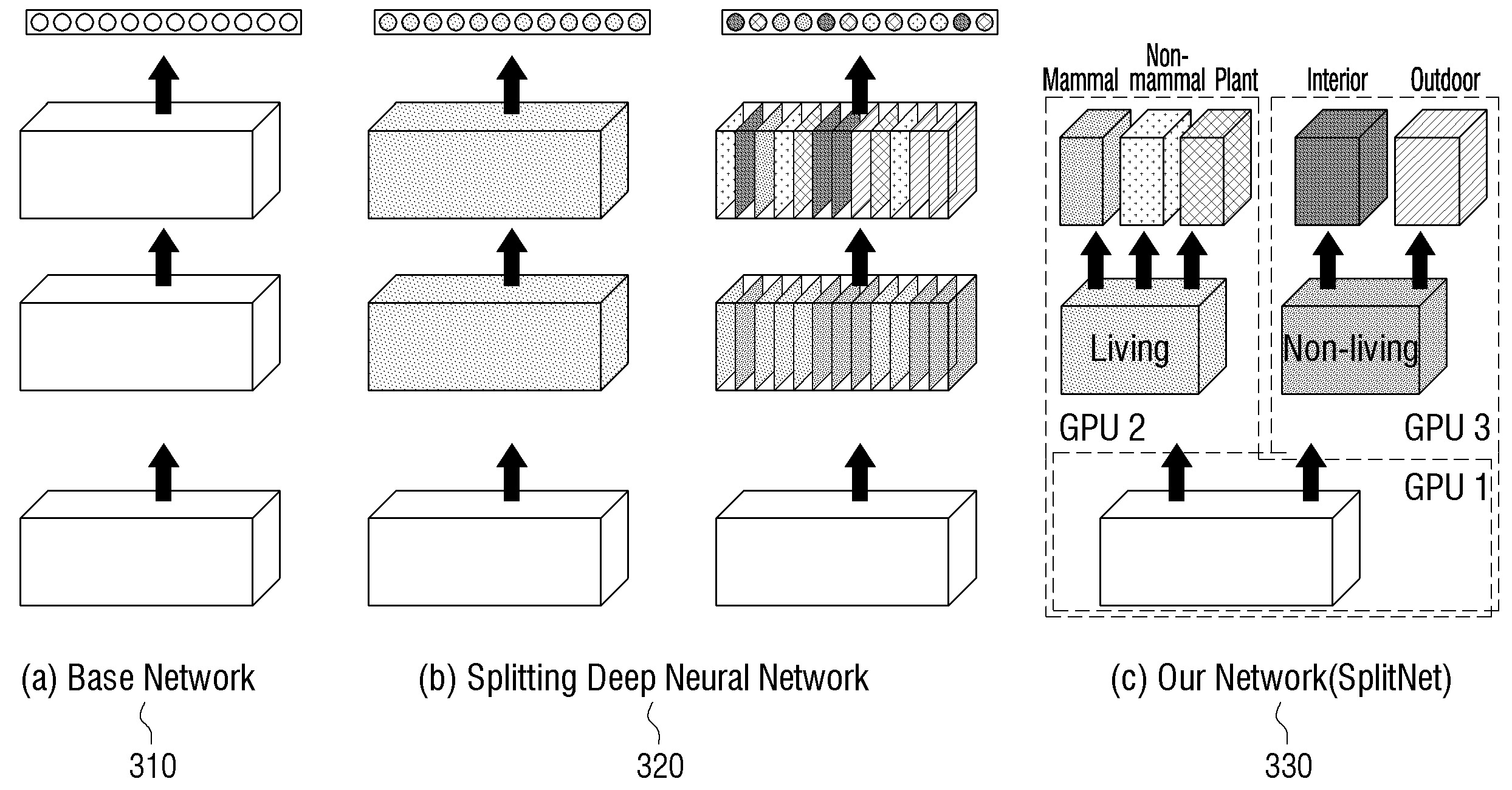

| 1 | 전자 장치에서의 학습 모델 최적화 방법에 있어서, 상기 전자 장치에서, 복수의 레이어로 구성되는 학습 모델의 파라미터 행렬 및 복수의 분할 변수를 초기화하는 단계;상기 전자 장치에서, 상기 학습 모델에 대한 손실 함수, 파라미터 감쇠 정규화 항 및 상기 파라미터 행렬 및 상기 복수의 분할 변수로 정의되는 분할 정규화 항을 포함하는 목적 함수가 최소화하도록 상기 복수의 분할 변수와 상기 학습 모델에 대한 블록 대각 행렬을 갖는 신규 파라미터 행렬을 산출하는 단계; 및상기 전자 장치에서, 상기 산출된 분할 변수에 기초하여 상기 복수의 레이어를 그룹에 따라 수직 분할하고, 상기 산출된 신규 파라미터 행렬을 상기 수직 분할된 레이어의 파라미터로 사용하여 상기 학습 모델을 재구성하는 단계;를 포함하는 학습 모델 최적화 방법. |

| 2 | 제1항에 있어서, 상기 초기화하는 단계는, 상기 파라미터 행렬을 랜덤하게 초기화하고, 상기 복수의 분할 변수를 상호 균일하지 않도록 초기화하는 학습 모델 최적화 방법. |

| 3 | 제1항에 있어서, 상기 산출하는 단계는, 상기 목적 함수가 최소화하도록 추계적 경사 하강(Stochastic Gradient Descent) 방법을 이용하는 학습 모델 최적화 방법. |

| 4 | 제1항에 있어서, 상기 분할 정규화 항은, 그룹 간의 연결을 억제하고 그룹 내의 연결만을 활성화하는 그룹 파라미터 정규화 항, 각 그룹이 직교하도록 하는 서로소 그룹 정규화 항 및 한 그룹의 크기가 과도하지 않도록 하는 균등 그룹 정규화 항을 포함하는 학습 모델 최적화 방법. |

| 5 | 제1항에 있어서, 상기 전자 장치에서, 상기 학습 모델에 대한 손실 함수 및 상기 파라미터 감쇠 정규화 항만 포함하는 제2 목적 함수가 최소화하도록 상기 재구성된 학습 모델에 대한 2차 신규 파라미터 행렬을 산출하는 단계; 및상기 전자 장치에서, 상기 산출된 2차 신규 파라미터 행렬을 상기 수직 분할된 레이어의 파라미터로 사용하여 상기 학습 모델을 최적화하는 단계;를 더 포함하는 학습 모델 최적화 방법. |

| 6 | 제5항에 있어서, 상기 전자 장치에서, 상기 최적화된 학습 모델 내의 수직 분할된 레이어 각각을 서로 다른 프로세서를 이용하여 병렬 처리하는 단계;를 더 포함하는 학습 모델 최적화 방법. |

| 7 | 전자 장치에 있어서, 복수의 레이어로 구성되는 학습 모델이 저장된 메모리; 및상기 학습 모델의 파라미터 행렬 및 복수의 분할 변수를 초기화하고, 상기 학습 모델에 대한 손실 함수, 파라미터 감쇠 정규화 항 및 상기 파라미터 행렬 및 상기 복수의 분할 변수로 정의되는 분할 정규화 항을 포함하는 목적 함수가 최소화하도록 상기 복수의 분할 변수와 상기 학습 모델에 대한 블록 대각 행렬을 갖는 신규 파라미터 행렬을 산출하고, 상기 산출된 분할 변수에 기초하여 상기 복수의 레이어를 그룹에 따라 수직 분할하고, 상기 산출된 신규 파라미터 행렬을 상기 수직 분할된 레이어의 파라미터로 사용하여 상기 학습 모델을 재구성하는 프로세서;를 포함하는 전자 장치. |

| 8 | 제7항에 있어서, 상기 프로세서는, 상기 파라미터 행렬을 랜덤하게 초기화하고, 상기 복수의 분할 변수를 상호 균일하지 않도록 초기화하는 전자 장치. |

| 9 | 제7항에 있어서, 상기 프로세서는, 상기 목적 함수가 최소화하도록 추계적 경사 하강(Stochastic Gradient Descent) 방법을 이용하는 전자 장치. |

| 10 | 제7항에 있어서, 상기 분할 정규화 항은, 그룹 간의 연결을 억제하고 그룹 내의 연결만을 활성화하는 그룹 파라미터 정규화 항, 각 그룹이 직교하도록 하는 서로소 그룹 정규화 항 및 한 그룹의 크기가 과도하지 않도록 하는 균등 그룹 정규화 항을 포함하는 전자 장치. |

| 11 | 제7항에 있어서, 상기 프로세서는, 상기 학습 모델에 대한 손실 함수 및 상기 파라미터 감쇠 정규화 항만 포함하는 제2 목적 함수가 최소화하도록 상기 재구성된 학습 모델에 대한 2차 신규 파라미터 행렬을 산출하고, 상기 산출된 2차 신규 파라미터 행렬을 상기 수직 분할된 레이어의 파라미터로 사용하여 상기 학습 모델을 최적화하는 전자 장치. |

| 12 | 전자 장치에서의 학습 모델 최적화 방법을 실행하기 위한 프로그램을 포함하는 컴퓨터 판독가능 기록 매체에 있어서,상기 학습 모델 최적화 방법은, 복수의 레이어로 구성되는 학습 모델의 파라미터 행렬 및 복수의 분할 변수를 초기화하는 단계;상기 학습 모델에 대한 손실 함수, 파라미터 감쇠 정규화 항 및 상기 파라미터 행렬 및 상기 복수의 분할 변수로 정의되는 분할 정규화 항을 포함하는 목적 함수가 최소화하도록 상기 복수의 분할 변수와 상기 학습 모델에 대한 블록 대각 행렬을 갖는 신규 파라미터 행렬을 산출하는 단계; 및상기 산출된 분할 변수에 기초하여 상기 복수의 레이어를 그룹에 따라 수직 분할하고, 상기 산출된 신규 파라미터 행렬을 상기 수직 분할된 레이어의 파라미터로 사용하여 상기 학습 모델을 재구성하는 단계;를 포함하는 컴퓨터 판독가능 기록 매체. |