| 번호 | 청구항 |

|---|---|

| 10 | 제8 항에 있어서,상기 적어도 두 개의 다중 해상도 시간 그리드는 동일한 공간 해상도를 가지고, 서로 다른 시간 해상도를 갖는 것을 특징으로 하는비디오 프레임 표현 장치. |

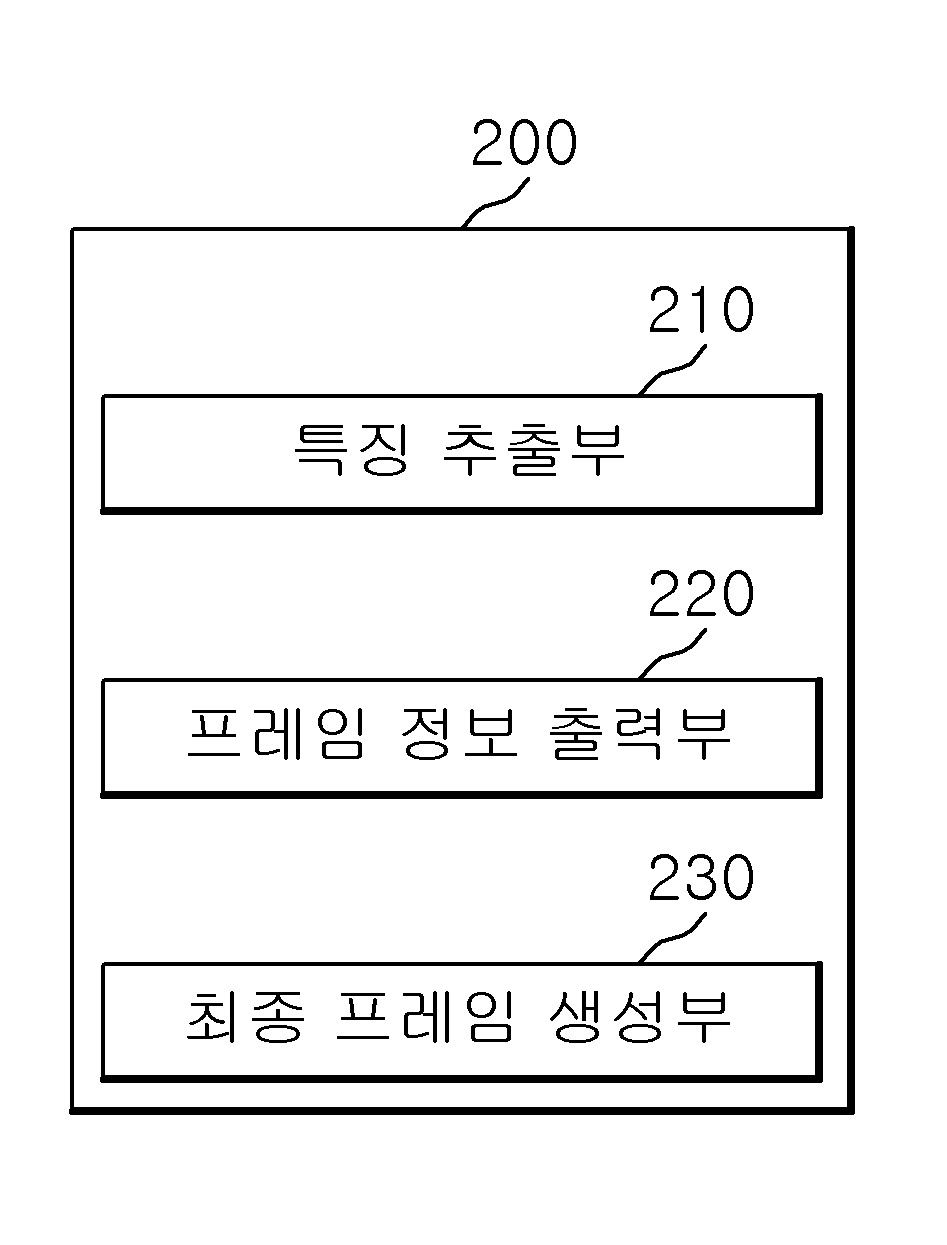

| 1 | 딥러닝 모델-적어도 두 개의 다중 해상도 시간 그리드 및 컨볼루션 블록을 포함함-을 이용하여 비디오의 프레임을 표현하는 방법으로서,특징 추출부가 상기 적어도 두 개의 다중 해상도 시간 그리드를 이용하여 상기 비디오의 프레임에 포함된 시간 좌표에 대한 특징을 추출하는 단계;프레임 정보 출력부가 상기 시간 좌표에 대한 특징을 상기 컨볼루션 블록에 입력하여 독립 프레임, 플로우 맵 및 가중치 맵을 출력하는 단계; 및최종 프레임 생성부가 상기 독립 프레임, 상기 플로우 맵 및 상기 가중치 맵을 기초로 상기 비디오의 최종 프레임을 생성하는 단계를 포함하고,상기 독립 프레임은 상기 시간 좌표에 대응되는 단위 프레임을 의미하고, 상기 플로우 맵은 인접한 비디오의 프레임 간의 유사한 패턴을 나타내는 광학 흐름을 의미하고, 상기 가중치 맵은 상기 독립 프레임 및 상기 플로우 맵에 대한 연산을 위한 가중치의 집합을 의미하는비디오 프레임 표현 방법. |

| 2 | 제1 항에 있어서,상기 비디오는 제1 시점의 제1 시간 좌표, 상기 제1 시점 이전의 제2 시간 좌표 및 상기 제1 시점 이후의 제3 시간 좌표를 포함하고,상기 시간 좌표에 대한 특징을 추출하는 단계에서,상기 제1 시간 좌표에 대한 특징을 추출하기 위하여 상기 제2 시간 좌표 및 상기 제3 시간 좌표에 대한 선형 보간(linear interpolation)이 이용되는비디오 프레임 표현 방법. |

| 3 | 제1 항에 있어서,상기 적어도 두 개의 다중 해상도 시간 그리드는 동일한 공간 해상도를 가지고, 서로 다른 시간 해상도를 갖는 것을 특징으로 하는비디오 프레임 표현 방법. |

| 4 | 제1 항에 있어서,상기 독립 프레임, 플로우 맵 및 가중치 맵을 출력하는 단계는,상기 플로우 맵을 이용하여 시간의 흐름에 따라 인접한 적어도 하나의 독립 프레임을 왜곡시켜서 적어도 하나의 왜곡 프레임을 결정하는 단계를 더 포함하는비디오 프레임 표현 방법. |

| 5 | 제4 항에 있어서,상기 최종 프레임을 생성하는 단계는,상기 적어도 하나의 왜곡 프레임과 상기 가중치 맵에 대한 연산에 기초하여 집계 프레임을 결정하는 단계; 및상기 집계 프레임, 상기 가중치 맵 및 상기 독립 프레임에 대한 연산에 기초하여 상기 최종 프레임을 생성하는 단계를 포함하는 비디오 프레임 표현 방법. |

| 6 | 제1 항에 있어서,상기 딥러닝 모델은,제t 시점(t는 자연수)의 제t 시간 좌표에 대응되는 제t 프레임을 포함하는 버퍼를 이용하여, 상기 제t 시간 좌표를 입력 받아 상기 제t 시간 좌표에 대응되는 제t 최종 프레임을 출력하도록 학습되며,상기 딥러닝 모델의 학습 과정에서, 상기 버퍼에 포함된 상기 제t 프레임은 상기 컨볼루션 블록을 이용하여 상기 제t 시간 좌표에 대한 특징으로부터 출력되는 제t 독립 프레임으로 업데이트되는비디오 프레임 표현 방법. |

| 7 | 제1 항에 있어서,상기 딥러닝 모델은,QAT(quantization-aware training) 기법을 이용하여 압축된 모델인비디오 프레임 표현 방법. |

| 8 | 딥러닝 모델-적어도 두 개의 다중 해상도 시간 그리드 및 컨볼루션 블록을 포함함-을 이용하여 비디오의 프레임을 표현하는 비디오 프레임 표현 장치로서,비디오 프레임 표현 프로그램이 저장된 메모리; 및상기 메모리에서 상기 비디오 프레임 표현 프로그램을 로드하여, 상기 비디오 프레임 표현 프로그램을 실행하는 프로세서를 포함하고,상기 프로세서는,상기 적어도 두 개의 다중 해상도 시간 그리드를 이용하여 상기 비디오의 프레임에 포함된 시간 좌표에 대한 특징을 추출하고,상기 시간 좌표에 대한 특징을 상기 컨볼루션 블록에 입력하여 독립 프레임, 플로우 맵 및 가중치 맵을 출력하고,상기 독립 프레임, 상기 플로우 맵 및 상기 가중치 맵을 기초로 상기 비디오의 최종 프레임을 생성하고,상기 독립 프레임은 상기 시간 좌표에 대응되는 단위 프레임을 의미하고, 상기 플로우 맵은 인접한 비디오의 프레임 간의 유사한 패턴을 나타내는 광학 흐름을 의미하고, 상기 가중치 맵은 상기 독립 프레임 및 상기 플로우 맵에 대한 연산을 위한 가중치의 집합을 의미하는 비디오 프레임 표현 장치. |

| 9 | 제8 항에 있어서,상기 비디오는 제1 시점의 제1 시간 좌표, 상기 제1 시점 이전의 제2 시간 좌표 및 상기 제1 시점 이후의 제3 시간 좌표를 포함하고,상기 제1 시간 좌표에 대한 특징을 추출하기 위하여 상기 제2 시간 좌표 및 상기 제3 시간 좌표에 대한 선형 보간(linear interpolation)이 이용되는비디오 프레임 표현 장치. |

| 11 | 제8 항에 있어서,상기 프로세서는,상기 플로우 맵을 이용하여 시간의 흐름에 따라 인접한 적어도 하나의 독립 프레임을 왜곡시켜서 적어도 하나의 왜곡 프레임을 결정하는비디오 프레임 표현 장치. |

| 12 | 제11 항에 있어서,상기 프로세서는,상기 적어도 하나의 왜곡 프레임과 상기 가중치 맵에 대한 연산에 기초하여 집계 프레임을 결정하고,상기 집계 프레임, 상기 가중치 맵 및 상기 독립 프레임에 대한 연산에 기초하여 상기 최종 프레임을 생성하는 비디오 프레임 표현 장치. |

| 13 | 제8 항에 있어서,상기 딥러닝 모델은,제t 시점(t는 자연수)의 제t 시간 좌표에 대응되는 제t 프레임을 포함하는 버퍼를 이용하여, 상기 제t 시간 좌표를 입력 받아 상기 제t 시간 좌표에 대응되는 제t 최종 프레임을 출력하도록 학습되며,상기 딥러닝 모델의 학습 과정에서, 상기 버퍼에 포함된 상기 제t 프레임은 상기 컨볼루션 블록을 이용하여 상기 제t 시간 좌표에 대한 특징으로부터 출력되는 제t 독립 프레임으로 업데이트되는비디오 프레임 표현 장치. |

| 14 | 제8 항에 있어서,상기 딥러닝 모델은,QAT(quantization-aware training) 기법을 이용하여 압축된 모델인비디오 프레임 표현 장치. |

| 15 | 컴퓨터 프로그램을 저장하고 있는 컴퓨터 판독 가능 기록매체로서,상기 컴퓨터 프로그램은, 프로세서에 의해 실행되면,특징 추출부가 딥러닝 모델에 포함된 적어도 두 개의 다중 해상도 시간 그리드를 이용하여 비디오의 프레임에 포함된 시간 좌표에 대한 특징을 추출하는 단계;프레임 정보 출력부가 상기 시간 좌표에 대한 특징을 상기 딥러닝 모델에 포함된 컨볼루션 블록에 입력하여 독립 프레임, 플로우 맵 및 가중치 맵을 출력하는 단계; 및최종 프레임 생성부가 상기 독립 프레임, 상기 플로우 맵 및 상기 가중치 맵을 기초로 상기 비디오의 최종 프레임을 생성하는 단계를 포함하고,상기 독립 프레임은 상기 시간 좌표에 대응되는 단위 프레임을 의미하고, 상기 플로우 맵은 인접한 비디오의 프레임 간의 유사한 패턴을 나타내는 광학 흐름을 의미하고, 상기 가중치 맵은 상기 독립 프레임 및 상기 플로우 맵에 대한 연산을 위한 가중치의 집합을 의미하는딥러닝 모델을 이용하여 비디오의 프레임을 표현하는 방법을 상기 프로세서가 수행하도록 하기 위한 명령어를 포함하는컴퓨터 판독 가능한 기록매체. |

| 16 | 컴퓨터 판독 가능한 기록매체에 저장되어 있는 컴퓨터 프로그램으로서,상기 컴퓨터 프로그램은, 프로세서에 의해 실행되면,특징 추출부가 딥러닝 모델에 포함된 적어도 두 개의 다중 해상도 시간 그리드를 이용하여 비디오의 프레임에 포함된 시간 좌표에 대한 특징을 추출하는 단계;프레임 정보 출력부가 상기 시간 좌표에 대한 특징을 상기 딥러닝 모델에 포함된 컨볼루션 블록에 입력하여 독립 프레임, 플로우 맵 및 가중치 맵을 출력하는 단계; 및최종 프레임 생성부가 상기 독립 프레임, 상기 플로우 맵 및 상기 가중치 맵을 기초로 상기 비디오의 최종 프레임을 생성하는 단계를 포함하고,상기 독립 프레임은 상기 시간 좌표에 대응되는 단위 프레임을 의미하고, 상기 플로우 맵은 인접한 비디오의 프레임 간의 유사한 패턴을 나타내는 광학 흐름을 의미하고, 상기 가중치 맵은 상기 독립 프레임 및 상기 플로우 맵에 대한 연산을 위한 가중치의 집합을 의미하는딥러닝 모델을 이용하여 비디오의 프레임을 표현하는 방법을 상기 프로세서가 수행하도록 하기 위한 명령어를 포함하는컴퓨터 프로그램. |