| 번호 | 청구항 |

|---|---|

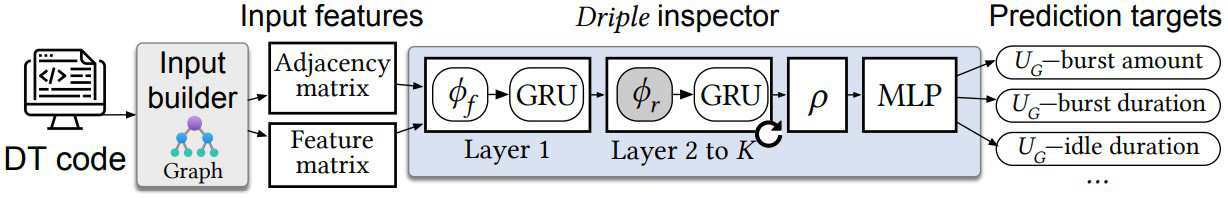

| 1 | 적어도 프로세서를 포함하는 컴퓨팅 장치에 의해 수행되는 예측 모델 생성 방법에 있어서,학습 데이터셋을 구축하는 단계; 및GNN(Graph Neural Network, 그래프 신경망) 모델을 학습하여 예측 모델을 생성하는 단계를 포함하고,상기 학습 데이터셋은 입력 데이터와 결과 데이터를 포함하고,상기 학습 데이터셋을 구축하는 단계는,분산 딥러닝 학습 코드(DT 코드, Distributed Training code)를 그래프로 변환하는 단계; 및상기 그래프로부터 인접 행렬(adjacency matrix)과 특징 행렬(feature matrix)을 추출하는 단계를 포함하는,예측 모델 생성 방법. |

| 2 | 제1항에 있어서,상기 결과 데이터는 GPU 활용률, GPU 메모리 활용률, 네트워크 TX 처리량, 네트워크 RX 처리량, GPU의 점유 시간, GPU 메모리의 점유 시간, 네트워크 TX의 점유 시간, 네트워크 RX의 점유 시간, GPU의 유휴 시간, GPU 메모리의 유휴 시간, 네트워크 TX의 유휴 시간, 및 네트워크 RX의 유휴 시간 중 적어도 하나를 포함하는,예측 모델 생성 방법. |

| 3 | 제1항에 있어서,상기 GNN은 GCN(Graph Convolutional Network), GIN(Graph Isomorphism Network), 또는 GAN(Graph Attention Network)인,예측 모델 생성 방법. |

| 4 | 제1항에 있어서,상기 GNN은 복수의 그래프 레이어들, 그래프 리드아웃 레이어, 및 MLP(Multi-Layer Perceptron) 레이어를 포함하는,예측 모델 생성 방법. |

| 5 | 제4항에 있어서,상기 그래프 레이어들 각각은 GRU(Gated Recurrent Unit)를 포함하는,예측 모델 생성 방법. |

| 6 | 제1항에 있어서,상기 예측 모델을 생성하는 단계 이후에,상기 예측 모델에 대한 전이 학습(Transfer Learning, TL)을 수행하는 단계를 더 포함하는,예측 모델 생성 방법. |

| 7 | 제6항에 있어서,상기 전이 학습을 수행하는 단계는 제2 학습 데이터셋을 이용하여 수행되고,상기 학습 데이터셋은 제1 DT 세팅(Distributed Training setting)에 대응하는 데이터셋이고,상기 제2 학습 데이터셋은 제2 DT 세팅에 대응하는 데이터셋이고,상기 제1 DT 세팅과 상기 제2 DT 세팅은 분산 딥러닝을 수행하는 GPU의 종류, 파라미터 서버(Parameter Server, PS)의 개수, 및 워커 노드(worker node)의 개수 중 적어도 하나가 상이한,예측 모델 생성 방법. |

| 8 | 제6항에 있어서,상기 전이 학습은 상기 예측 모델에 포함되는 복수의 그래프 레이어들 중 적어도 일부의 그래프 레이어의 파라미터들과 상기 예측 모델에 포함되는 MLP 레이어의 파라미터들 중 적어도 하나만을 업데이트하는,예측 모델 생성 방법. |

| 9 | 제6항에 있어서,상기 전이 학습은 상기 예측 모델에 포함되는 복수의 그래프 레이어들 중 후반부의 절반의 레이어들의 파라미터들과 상기 MLP 레이어의 파라미터들만을 업데이트하는,예측 모델 생성 방법. |

| 10 | 제1항 내지 제9항에 기재된 예측 모델 생성 방법에 의하여 생성된 예측 모델을 이용한 예측 방법에 있어서,예측 대상 입력 데이터를 생성하는 단계; 및상기 예측 대상 입력 데이터를 상기 예측 모델에 입력하여 예측을 수행하는 단계를 포함하는,예측 방법. |